Cerebras Systems, fabricante del procesador más grande del mundo, ha batido el récord del modelo de IA más complejo entrenado con un solo dispositivo.

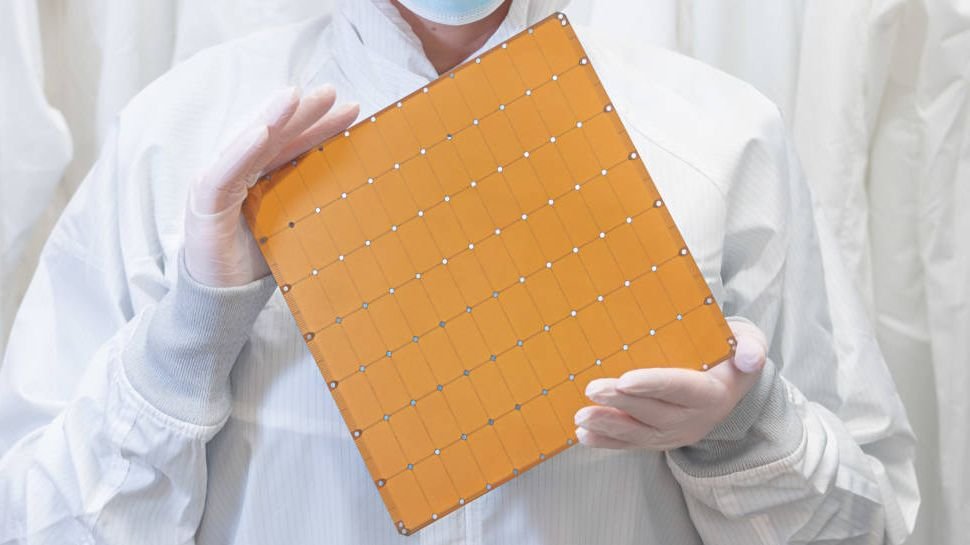

Usando un sistema CS-2, impulsado por el chip del tamaño de una oblea de la compañía (WSE-2), Cerebras ahora puede entrenar modelos de IA con hasta 20 mil millones de parámetros a través de nuevas optimizaciones a nivel de software.

La compañía dice que este avance resolverá uno de los problemas más frustrantes para los ingenieros de IA: la necesidad de particionar modelos a gran escala en miles de GPU. El resultado es una oportunidad para reducir drásticamente el tiempo necesario para desarrollar y entrenar nuevos modelos.

Cerebras lleva la IA a las masas

En subdisciplinas como el procesamiento del lenguaje natural (NLP), el rendimiento del modelo se correlaciona linealmente con la cantidad de parámetros. En otras palabras, cuanto más grande sea el modelo, mejor será el resultado final.

Hoy en día, el desarrollo de productos de IA a gran escala tradicionalmente implica la transmisión de un modelo a través de una gran cantidad de GPU o aceleradores, ya sea porque hay demasiados parámetros para almacenar en la memoria o porque el rendimiento informático es insuficiente para manejar las cargas de trabajo de entrenamiento.

"Este proceso es doloroso y suele llevar meses", explicó Cerebras. Para empeorar las cosas, el proceso es único para cada par de clústeres de cómputo de la red, por lo que el trabajo no es transferible entre diferentes clústeres de cómputo o redes neuronales. Es completamente a medida. »

Aunque los modelos más complejos constan de más de 20 mil millones de parámetros, la capacidad de entrenar modelos de IA de escala relativamente grande en un solo dispositivo CS-2 elimina estos cuellos de botella para muchos, acelerando el desarrollo para los actores existentes y democratizando el acceso para aquellos que antes no podían hacerlo. . participar en el espacio.

“La capacidad de Cerebras para ofrecer modelos de lenguaje grandes al público en general con un acceso fácil y rentable marca el comienzo de una nueva era emocionante en la IA. Brinda a las organizaciones que no pueden gastar decenas de millones una vía de acceso fácil y económica a la PNL de grandes ligas”, dijo Dan Olds, director de investigación de Intersect360 Research.

"Será interesante ver las nuevas aplicaciones y los descubrimientos que harán los clientes de CS-2 al entrenar los modelos de clase GPT-3 y GPT-J en conjuntos de datos masivos".

Además, Cerebras insinuó que su sistema CS-2 podría manejar modelos aún más grandes en el futuro, con "incluso trillones de parámetros". Mientras tanto, encadenar varios sistemas CS-2 podría allanar el camino para redes de IA más grandes que el cerebro humano.