- Сравнение

- Учебники

- La nueva tecnología fotográfica de Google da miedo y es muy problemática

Google tiene una operación masiva de aprendizaje automático, por lo que no es de extrañar que la compañía lo aplique a cada dato que le proporcionamos, pero hay algo en estropear nuestras fotos que parece transgresor, sea cual sea la sonrisa que intente Google. pontelo.

Hubo muchas cosas en el discurso de apertura de Google I / O 2021 que tocaron una nota extraña, como celebrar sus 'principios de inteligencia artificial' después de tratar a su antiguo experto en ética de inteligencia artificial, el Dr. Timnit Gebru, lo que llevó a la compañía a liderar a sus científicos. "Sea más positivo" sobre la IA.

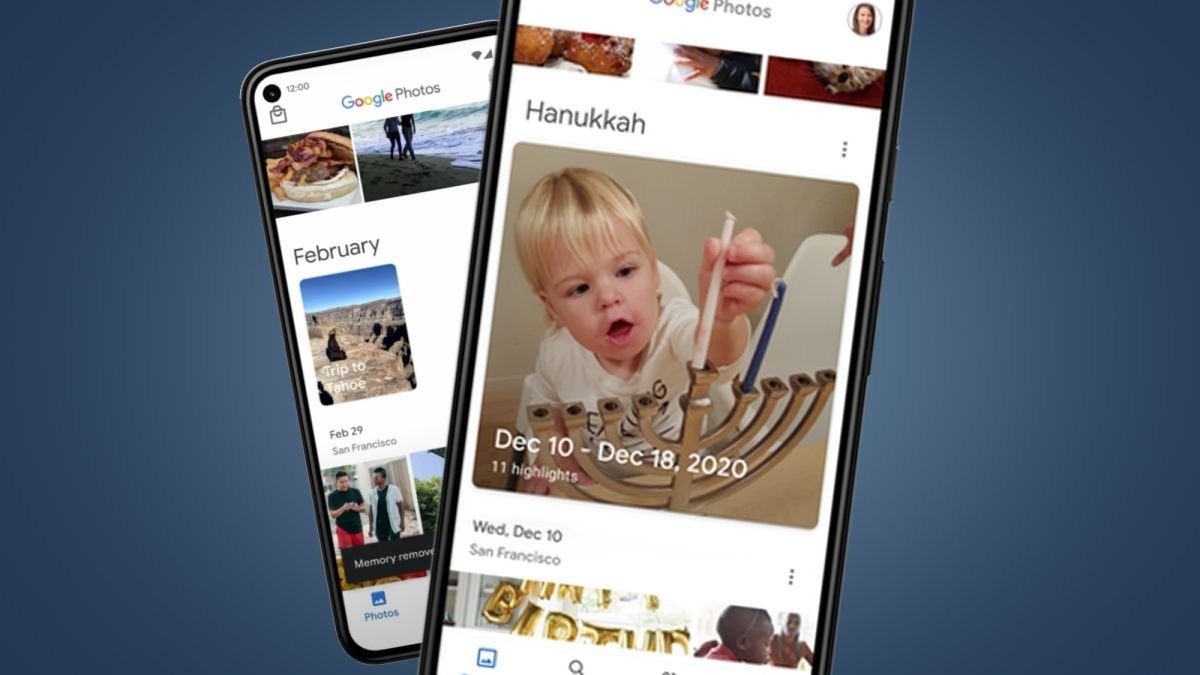

Pero fue la parte del discurso de apertura de Shimrit Ben-Yair, director de Google Photos, la que resultó particularmente molesta. Durante su presentación, mostró cómo la tecnología de aprendizaje automático de Google pudo analizar todas sus fotos, identificar similitudes menos reconocidas en toda su colección de fotos y agrupar sus fotos en grupos en consecuencia.

(Crédito de la imagen: Google)

Es decir, Google ejecuta cada foto que le das a través de algoritmos de aprendizaje automático muy específicos e identifica detalles muy específicos de tu vida, como el hecho de que te gusta viajar por el mundo con una bolsa mía, una parte trasera naranja específica, por ejemplo.

Afortunadamente, Google al menos reconoce que esto podría ser problemático si, por ejemplo, eres transgénero y el algoritmo de Google decide que quiere crear una colección de fotos previas a la transición. Google entiende que esto puede ser doloroso para usted, por lo que tiene la opción completa de eliminar la foto ofensiva de las colecciones en el futuro. También puede pedirles que eliminen cualquier foto tomada en una fecha específica que pueda ser dolorosa, como el día en que murió un ser querido.

Todo esto es mejor que no tener esta opción en absoluto, pero la responsabilidad aún recae en usted, el usuario, que siempre lo es, siempre lo es. ¿Qué es un poco doloroso para algunos cuando Google tiene nuevas funciones para implementar que nadie estaba pidiendo?

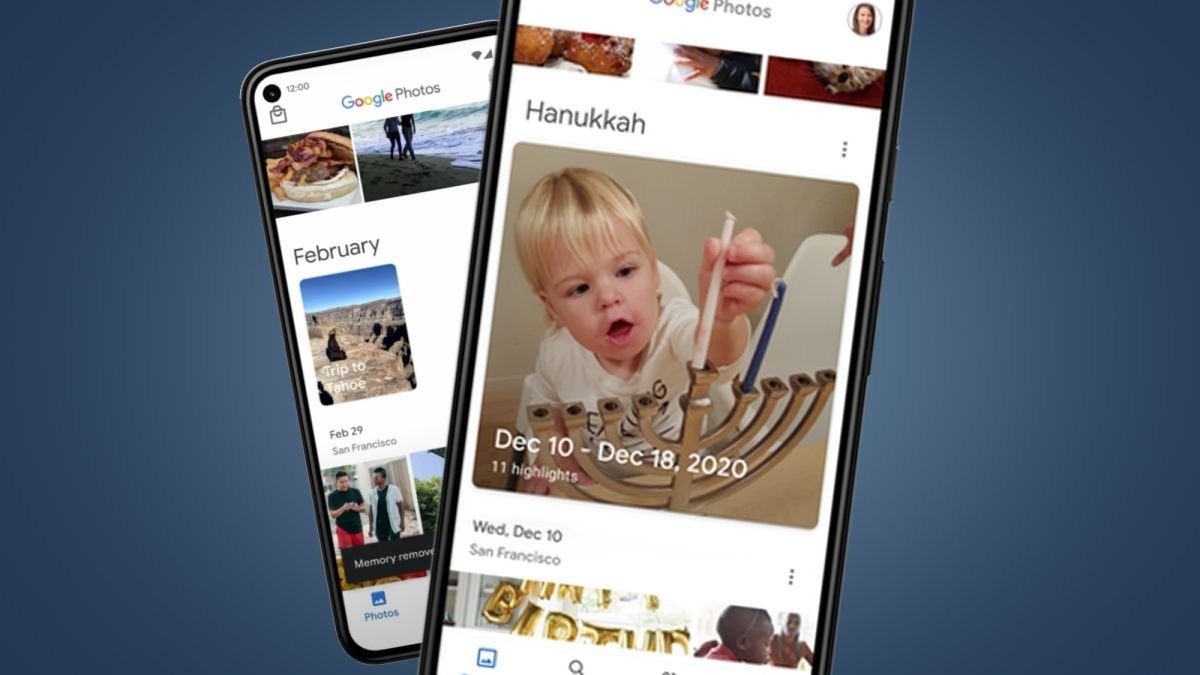

Luego llegamos a la parte de la presentación donde Google tomaría una selección de dos o tres fotos tomadas juntas, como cuando tomas muchas fotos seguidas para capturar una en la que nadie está parpadeando en una foto grupal, y aplica: su aprendizaje automático para generar una pequeña "foto cinematográfica" con ellos.

Esta función, introducida por primera vez en diciembre de 2020, utilizará el aprendizaje automático para insertar fotogramas completamente fabricados entre estas fotos para generar esencialmente un GIF, recreando un evento en vivo de una manera que es un facsímil del evento tal como sucedió. Énfasis en el envío de faxes.

(Crédito de la imagen: Google)

Google presenta esto como una ayuda para recordar fotos antiguas, pero eso no es lo que es, es el comienzo del fin de la reminiscencia tal como la conocemos. ¿Por qué confiar en tu memoria cuando Google solo puede generar una para ti? No importa si crea una grabación de algo que en realidad no sucedió y se lo presenta como si sucediera.

Por supuesto, tus ojos podrían haber parpadeado "algo así" entre esas dos fotos y no es como si Google te estuviera obligando a hacer líneas de coca en una fiesta cuando no estabas haciendo una, tal o cual cosa. Pero cuando se trata de lo que es ético y lo que no lo es, no hay lugar para el “género”. Estos son los tipos de elecciones que nos llevan por caminos que no queremos tomar, y cada paso en un camino nos dificulta regresar.

Si hay algo que realmente deberíamos haber aprendido durante la última década, es no tener una fe tan ciega en los algoritmos de aprendizaje automático que tienen el poder de distorsionar nuestra percepción de la realidad científica. QAnon es tanto un producto de aprendizaje automático como Netflix, pero ahora vamos a poner nuestros álbumes de fotos en el altar de la IA y llamar a lo que sea que surja "Recuerdos". Mientras tanto, se gasta una gran cantidad de energía real en ejecutar todos estos algoritmos en los centros de datos a medida que avanza el cambio climático.

Con cada nuevo avance de la plataforma de aprendizaje automático de Google, se vuelve cada vez más evidente que realmente debería escuchar lo que los especialistas en ética como el Dr. Gebru están tratando de decirle, y se vuelve aún más obvio que no tiene interés en hacerlo.